مواجهة nvlink؟عمالقة التكنولوجيا مثل Intel و AMD و Microsoft و Broadcom تشكل ualink

يقوم ثمانية عمالقة بالتكنولوجيا ، بما في ذلك Intel و Google و Microsoft و Meta ، بإنشاء مجموعة صناعة جديدة تسمى مجموعة Ualink لتوجيه مكونات تربط رقائق تسريع الذكاء الاصطناعى ضمن مراكز البيانات.

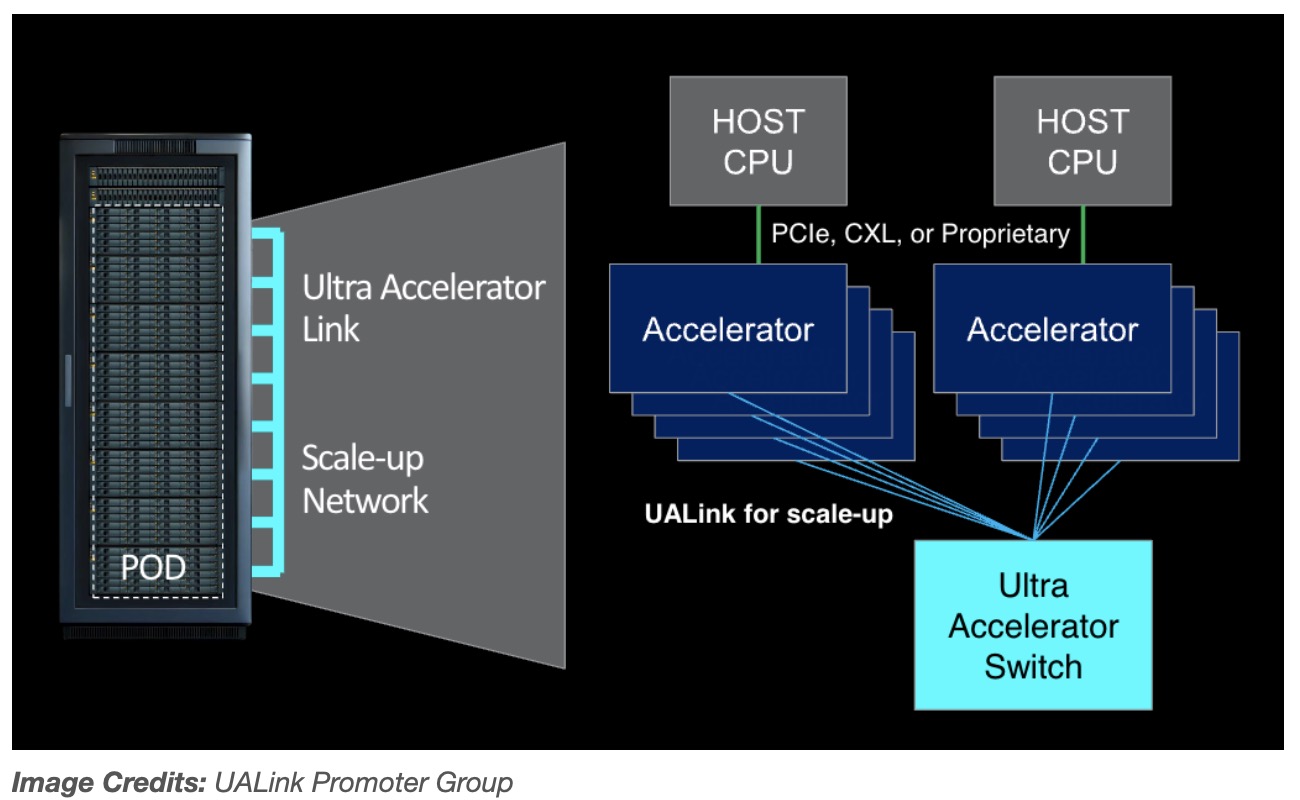

تم الإعلان عن إنشاء فريق الترويج Ualink يوم الخميس ، كما يشمل أعضائه AMD و HP Enterprise و Broadcom و Cisco.اقترحت المجموعة معيارًا جديدًا للصناعة لتوصيل عدد متزايد من رقائق تسريع AI في الخوادم.بالمعنى الواسع ، يعد تسارع AI شريحة مصممة من وحدة معالجة الرسومات إلى حل مخصص لتسريع التدريب ، والضبط ، وتشغيل نماذج الذكاء الاصطناعي.

"تحتاج الصناعة إلى معيار مفتوح يمكن دفعه بسرعة إلى الأمام ، مما يسمح لشركات متعددة بإضافة قيمة إلى النظام البيئي بأكمله بتنسيق مفتوح."وقال فورست نورود ، المدير العام لشركة AMD Data Center Solutions ، في إحاطة يوم الأربعاء: "تحتاج الصناعة إلى معيار يسمح بالابتكار بحدوث وتيرة سريعة دون التقييد من قبل أي شركة واحدة".

سيتم توصيل الإصدار الأول من المعيار المقترح ، UALINK 1.0 , حتى 1024 من تسارع الذكاء الاصطناعي في جراب واحد للحوسبة - GPU فقط.(تُعرّف المجموعة POD بأنها واحدة أو عدة رفوف في خادم.) يعتمد Ualink 1.0 على "المعايير المفتوحة" ويتضمن بنية AMD Infinite.سيسمح ذلك بتحميل وتخزين ذاكرة إضافية بين مسرعات AI ، وتحسين السرعة بشكل عام وتقليل زمن انتقال نقل البيانات مقارنة بمواصفات التوصيل البيني الحالي.

ذكرت المجموعة أنها ستنشئ تحالفًا ، تحالف Ualink ، في الربع الثالث للإشراف على التطوير المستقبلي لمعايير Ualink.سيتم توفير Ualink 1.0 للشركات التي تنضم إلى التحالف خلال نفس الفترة ، مع مواصفات تحديث عرض النطاق الترددي الأعلى لـ Ualink 1.1.من المخطط أن يتم إطلاقه في الربع الرابع من 2024.

وقال نورود إنه سيتم إطلاق الدفعة الأولى من منتجات Ualink "في السنوات القادمة".

إن NVIDIA ، أكبر شركة تصنيع AI AI SCELERATOR حتى الآن ، مع حصة السوق المقدرة من 80 ٪ إلى 95 ٪ ، غائبة بشكل واضح عن قائمة أعضاء المجموعة.رفضت Nvidia التعليق على هذا.لكن ليس من الصعب معرفة سبب عدم حريص هذه الشركة المصنعة للرقائق على دعم المواصفات القائمة على تكنولوجيا المنافسين.

أولاً ، توفر NVIDIA تقنية ربط الملكية الخاصة بها ل GPUs داخل خوادم مركز البيانات.قد لا تكون الشركة على استعداد لدعم المعايير بناءً على تكنولوجيا المنافسين.

ثم يأتي حقيقة أن Nvidia تعمل من موقف القوة والتأثير الهائل.

في أحدث الربع المالي في NVIDIA (Q1 2025) ، زادت مبيعات مركز البيانات ، بما في ذلك مبيعات رقائق الذكاء الاصطناعى ، بأكثر من 400 ٪ مقارنة بالفترة نفسها من العام الماضي.إذا واصلت Nvidia مسارها الحالي للتطوير ، فسوف تتجاوز Apple في مرحلة ما من هذا العام لتصبح أكثر الشركات قيمة في العالم.

لذلك ، بعبارات بسيطة ، إذا لم ترغب Nvidia في المشاركة ، فلا تحتاج إلى المشاركة.

بالنسبة إلى Amazon Web Services (AWS) ، وهو عملاق السحابة العام الوحيد الذي لم يساهم في Ualink ، فقد يكون في وضع الانتظار والرؤية لأنه يقلل من جهود أجهزة التسريع الداخلية المختلفة.يمكن أن تكون أيضًا AWS ، والاعتماد على سيطرتها على سوق الخدمات السحابية وعدم رؤية أي أهمية استراتيجية في معارضة NVIDIA ، والتي وفرت معظم وحدات معالجة الرسومات الخاصة بها لعملائها.

لم يرد AWS على طلب تعليق TechCrunch.

في الواقع ، يبدو أن أكبر المستفيدين من Ualink - بصرف النظر عن AMD و Intel - هم Microsoft و Meta و Google ، الذين أنفقوا مليارات الدولارات لشراء Nvidia GPUs لقيادة غيومهم وتدريب نماذج AI المتزايدة.الكل يريد التخلص من المورد الذي يرونه المهيمن بشكل مفرط في النظام البيئي لأجهزة الذكاء الاصطناعي.

لدى Google رقائق مخصصة ، TPU ، و Axion لتدريب وتشغيل نماذج الذكاء الاصطناعي.Amazon لديها العديد من عائلات رقاقة الذكاء الاصطناعي.انضمت Microsoft إلى المنافسة بين Maia و Cobalt العام الماضي.Meta يحسن سلسلة مسرعها.

وفي الوقت نفسه ، يقال إن Microsoft وشريكها المقرب Openai يخططون لإنفاق ما لا يقل عن 100 مليار دولار على الحاسوب الخارق لتدريب نماذج الذكاء الاصطناعي ، والتي سيتم تجهيزها مع رقائق الكوبالت و MAIA المستقبلية.ستحتاج هذه الرقائق إلى شيء لتوصيلها معًا - ربما ستكون ualink.

"تحتاج الصناعة إلى معيار مفتوح يمكن دفعه بسرعة إلى الأمام ، مما يسمح لشركات متعددة بإضافة قيمة إلى النظام البيئي بأكمله بتنسيق مفتوح."وقال فورست نورود ، المدير العام لشركة AMD Data Center Solutions ، في إحاطة يوم الأربعاء: "تحتاج الصناعة إلى معيار يسمح بالابتكار بحدوث وتيرة سريعة دون التقييد من قبل أي شركة واحدة".

سيتم توصيل الإصدار الأول من المعيار المقترح ، UALINK 1.0 , حتى 1024 من تسارع الذكاء الاصطناعي في جراب واحد للحوسبة - GPU فقط.(تُعرّف المجموعة POD بأنها واحدة أو عدة رفوف في خادم.) يعتمد Ualink 1.0 على "المعايير المفتوحة" ويتضمن بنية AMD Infinite.سيسمح ذلك بتحميل وتخزين ذاكرة إضافية بين مسرعات AI ، وتحسين السرعة بشكل عام وتقليل زمن انتقال نقل البيانات مقارنة بمواصفات التوصيل البيني الحالي.

ذكرت المجموعة أنها ستنشئ تحالفًا ، تحالف Ualink ، في الربع الثالث للإشراف على التطوير المستقبلي لمعايير Ualink.سيتم توفير Ualink 1.0 للشركات التي تنضم إلى التحالف خلال نفس الفترة ، مع مواصفات تحديث عرض النطاق الترددي الأعلى لـ Ualink 1.1.من المخطط أن يتم إطلاقه في الربع الرابع من 2024.

وقال نورود إنه سيتم إطلاق الدفعة الأولى من منتجات Ualink "في السنوات القادمة".

إن NVIDIA ، أكبر شركة تصنيع AI AI SCELERATOR حتى الآن ، مع حصة السوق المقدرة من 80 ٪ إلى 95 ٪ ، غائبة بشكل واضح عن قائمة أعضاء المجموعة.رفضت Nvidia التعليق على هذا.لكن ليس من الصعب معرفة سبب عدم حريص هذه الشركة المصنعة للرقائق على دعم المواصفات القائمة على تكنولوجيا المنافسين.

أولاً ، توفر NVIDIA تقنية ربط الملكية الخاصة بها ل GPUs داخل خوادم مركز البيانات.قد لا تكون الشركة على استعداد لدعم المعايير بناءً على تكنولوجيا المنافسين.

ثم يأتي حقيقة أن Nvidia تعمل من موقف القوة والتأثير الهائل.

في أحدث الربع المالي في NVIDIA (Q1 2025) ، زادت مبيعات مركز البيانات ، بما في ذلك مبيعات رقائق الذكاء الاصطناعى ، بأكثر من 400 ٪ مقارنة بالفترة نفسها من العام الماضي.إذا واصلت Nvidia مسارها الحالي للتطوير ، فسوف تتجاوز Apple في مرحلة ما من هذا العام لتصبح أكثر الشركات قيمة في العالم.

لذلك ، بعبارات بسيطة ، إذا لم ترغب Nvidia في المشاركة ، فلا تحتاج إلى المشاركة.

بالنسبة إلى Amazon Web Services (AWS) ، وهو عملاق السحابة العام الوحيد الذي لم يساهم في Ualink ، فقد يكون في وضع الانتظار والرؤية لأنه يقلل من جهود أجهزة التسريع الداخلية المختلفة.يمكن أن تكون أيضًا AWS ، والاعتماد على سيطرتها على سوق الخدمات السحابية وعدم رؤية أي أهمية استراتيجية في معارضة NVIDIA ، والتي وفرت معظم وحدات معالجة الرسومات الخاصة بها لعملائها.

لم يرد AWS على طلب تعليق TechCrunch.

في الواقع ، يبدو أن أكبر المستفيدين من Ualink - بصرف النظر عن AMD و Intel - هم Microsoft و Meta و Google ، الذين أنفقوا مليارات الدولارات لشراء Nvidia GPUs لقيادة غيومهم وتدريب نماذج AI المتزايدة.الكل يريد التخلص من المورد الذي يرونه المهيمن بشكل مفرط في النظام البيئي لأجهزة الذكاء الاصطناعي.

لدى Google رقائق مخصصة ، TPU ، و Axion لتدريب وتشغيل نماذج الذكاء الاصطناعي.Amazon لديها العديد من عائلات رقاقة الذكاء الاصطناعي.انضمت Microsoft إلى المنافسة بين Maia و Cobalt العام الماضي.Meta يحسن سلسلة مسرعها.

وفي الوقت نفسه ، يقال إن Microsoft وشريكها المقرب Openai يخططون لإنفاق ما لا يقل عن 100 مليار دولار على الحاسوب الخارق لتدريب نماذج الذكاء الاصطناعي ، والتي سيتم تجهيزها مع رقائق الكوبالت و MAIA المستقبلية.ستحتاج هذه الرقائق إلى شيء لتوصيلها معًا - ربما ستكون ualink.